什么是 Ollama

Ollama 是支持本地运行大语言模型的工具(基于Go语言实现),支持 Windows、Linux 和 MacOS 操作系统。Ollama 简化了下载、安装和与 LLM 交互的过程。通过简单的命令行,即可在本地机器启动和运行模型。Ollama 支持多种硬件配置,即使在没有高性能 GPU 的情况下,也能在 CPU 上运行模型。

Ollama 官方网站:https://ollama.com/

Ollama 支持哪些模型

Ollama 支持的模型,网站可查 https://ollama.com/library

Ollama 模型默认位置

模型下载后存放在下面的位置:

Windows: C:\Users\<username>\.ollama\models

Linux: /usr/share/ollama/.ollama/models

Linux: /home/<username>/.ollama/models

macOS: ~/.ollama/models

可通过修改环境变量 OLLAMA_MODELS 修改模型默认存放位置

Modelfile 作用

调整模型参数,以下命令查看某个模型的 modelfile 设置

ollama show --modelfile qwen0_5b

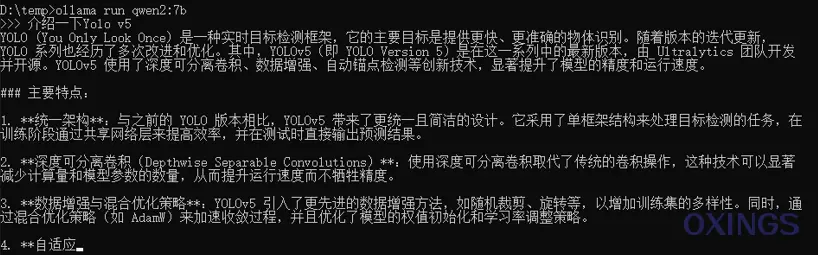

Ollama 终端格式

默认返回 markdown 格式,如下

Ollama 常用命令

serve Start ollama

create Create a model from a Modelfile

show Show information for a model

run Run a model

pull Pull a model from a registry

push Push a model to a registry

list List models

cp Copy a model

rm Remove a model

help Help about any command

Ollama 官方文档

https://github.com/ollama/ollama/tree/main/docs

Ollama 交互界面

有多个第三方前端交互界面,如:https://github.com/open-webui/open-webui